«Привітання від зірок»: як пропаганда підробила відеозвернення голлівудських акторів проти прем'єра Вірменії напередодні виборів

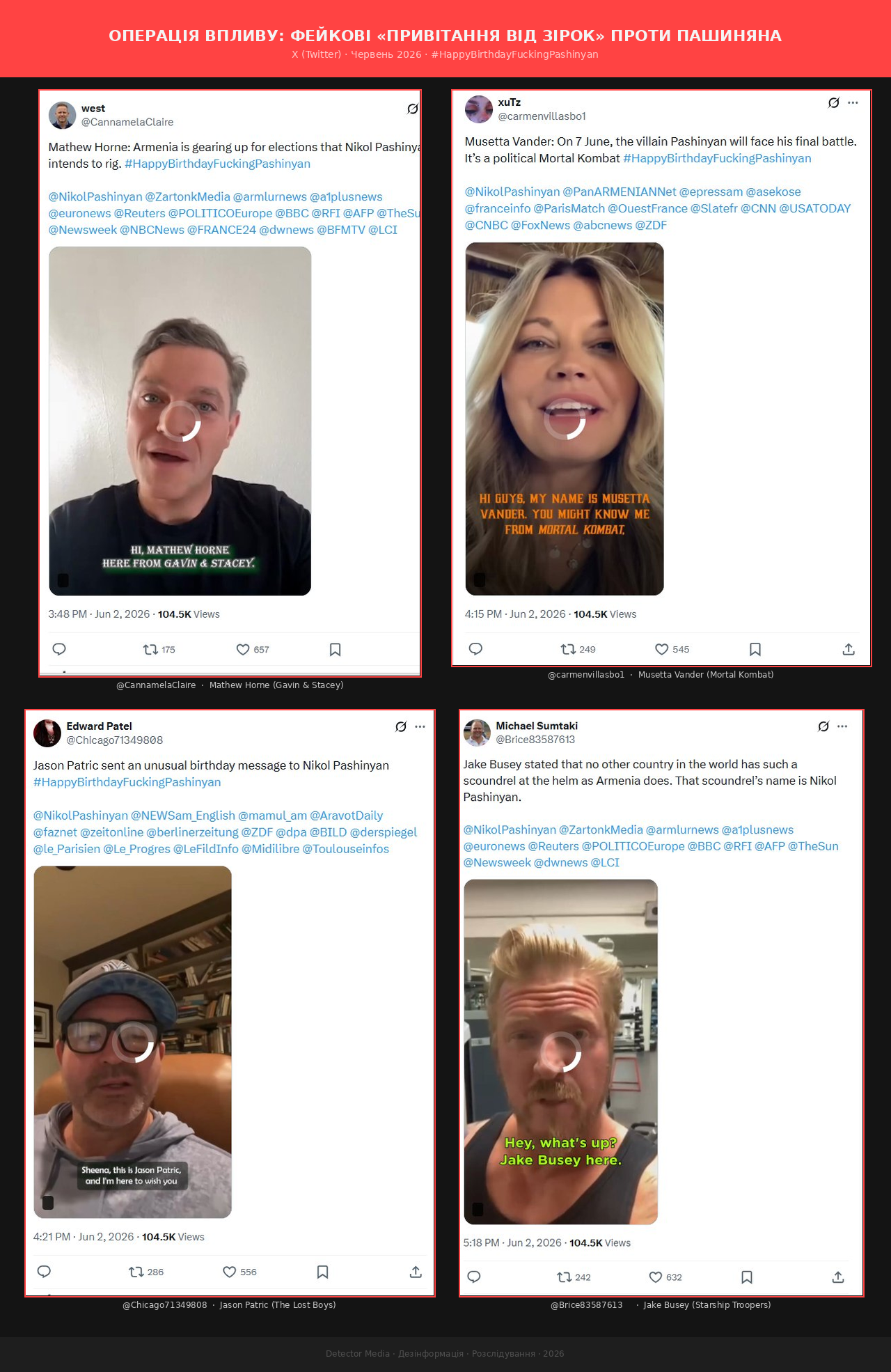

Наприкінці травня та на початку червня аналітики "Детектора Медіа" зафіксували поширення нової дезінформаційної кампанії проти прем'єра Вірмені Ніколи Пашиняна на платформі Х (твіттер), спрямованої на англомовну аудиторію. Цього разу зловмисники використали нову тактику - начебто привітання від зірок Голлівуду різних років, які закликають глядачів не голосувати за Пашиняна та його партію на виборах до парламенту Вірменії 7 червня. Відеоролики, ймовірно, стоврені за допомогою генеравтиного ШІ містять хештег #HappyBirthdayFuckingPashinyan (З днем народження, чортів Пашинян). Слід нагадати, що день народження Ніколи Пашиняна - 1 червня.

Хто насправді ці актори, та у яких фільмах чи серіалах вони знімалися

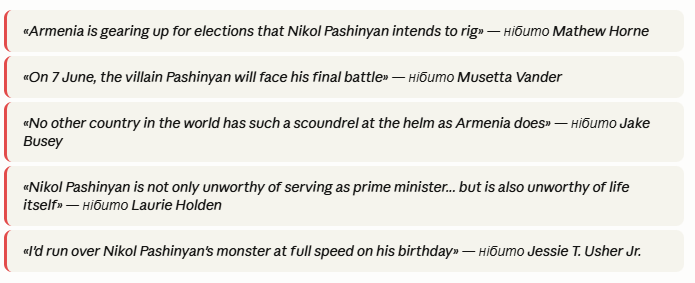

Mathew Horne — англійський актор, найбільш відомий за ролями у «Gavin & Stacey» та «Bad Education» на BBC.

Musetta Vander відома насамперед роллю Сіндел у «Mortal Kombat: Annihilation» — що робить маніпуляцію з хештегом «Mortal Kombat» особливо цинічною.

Jake Busey — американський актор, відомий за «Starship Troopers» та роллю журналіста у третьому сезоні «Stranger Things».

Laurie Holden — акторка, найбільш впізнавана за роллю Андреа у «The Walking Dead» та Маріти Коваррубіас у «The X-Files».

Jessie T. Usher Jr. найбільш відомий роллю A-Train у серіалі «The Boys» — і тут маніпулятори не випадково обрали саме його: посилання на «суперсили, як у мого персонажа», вкладені у його уста, сигналізують, що фейкороби знали, кого обирають.

Як працює тактика «фейкових привітань від зірок»

На платформах типу Cameo будь-хто може замовити персоналізоване відео-привітання від відомого актора або зірки за відносно невелику суму. Замовник формулює привід та текст — наприклад, «привіт від Джека на день народження». Актор записує відео з нейтральним або привітальним текстом, не підозрюючи про справжні наміри замовника. Замовник за допомогою ШІ-інструментів замінює аудіодоріжку або субтитри, вкладаючи в уста актора зовсім інший — провокаційний або політично заряджений — текст. У даному випадку фейк публікується в соцмережах через мережу фейкових акаунтів із тегаванням справжніх акаунтів провідних медіа (BBC, Reuters, CNN, Euronews та ін.), щоб привернути увагу журналістів і розширити охоплення.

Контент висить у відкритому доступі упродовж критичного вікна — у даному випадку останній тиждень передвиборчої кампанії перед парламентськими виборами 7 червня — і видаляється лише після того, як завдає максимальної шкоди.

Прецеденти використання тактики «фейкових привітань від зірок»

Проти Володимира Зеленського у 2023 році. За даними Microsoft Threat Analysis Center, проросійські актори купили на Cameo відео таких зірок, як Елайджа Вуд, Майк Тайсон, Прісцилла Преслі, та змонтували їх так, ніби ті закликають Зеленського «звернутися по допомогу від залежності». Відео поширювали проросійські Telegram-канали та держмедіа.

Проти Маїй Санду (прем'єрка Молдови) у 2024 році. Ліндсі Лохан та інші зірки були змонтовані у фейкове «термінове звернення» до президентки Молдови з вимогою піти у відставку — у розпал виборчкої кампанії, під час якої гаслом Санду був курс орієнтований на інтеграцію з ЄС.

Чому це небезпечно

Відео з упізнаваними зірками формує ілюзію «міжнародного засудження» лідера. Хештег із образливим словом навмисно провокує емоційне відторгнення. Тегавання провідних медів — спроба спонукати редакції до перевірки та мимовільного поширення. Таймінг перед виборами розрахований на максимальний вплив на вірменську діаспору та англомовну аудиторію.

Росія намагається дискредитувати чинного прем'єр-міністра Нікола Пашиняна, звинувачуючи його в зраді інтересів країни — та погрожує вірменам війною, якщо вони не оберуть потрібного Кремлю кандидата.

Читайте статтю Центру досліджень "Детектора медіа": «Український сценарій». Як Москва запускає апокаліптичні наративи напередодні виборів у Вірменії