Кремль використовує Pogled.info та Faktibg.com для поширення дезінформації в Болгарії

Розслідування Светослава Малінова, Center for the Study of Democracy (CSD), поширене мережею A4E Counter Disinformation Network (CDN) показує, як кремлівська пропагандистська інфраструктура системно поширює проросійську дезінформацію через болгарський інформаційний простір. У центрі цієї схеми — сайт Pogled.info, який з лютого 2022 року регулярно передруковував матеріали з пов’язаних із Кремлем і підсанкційних медіа, зокрема RIA Novosti, Sputnik та інші.

Спочатку матеріали ще містили сліди першоджерел, але наприкінці 2025 року тактика змінилася: Pogled.info перейшов до моделі, де публікації подаються як власна аналітика без прозорого посилання на джерело. Це важливо, бо така зміна не лише ускладнює виявлення походження контенту, а й допомагає приховати зв’язок із підсанкційними медіа. Зокрема, це порушує Директиву ЄС 2022/350 від 1 березня 2022 року, яка забороняє трансляцію контенту з російських державних медіа, а саме RT («Russia Today») та «Спутник», на території ЄС або спрямованого на аудиторію в ЄС.

Як працює схема

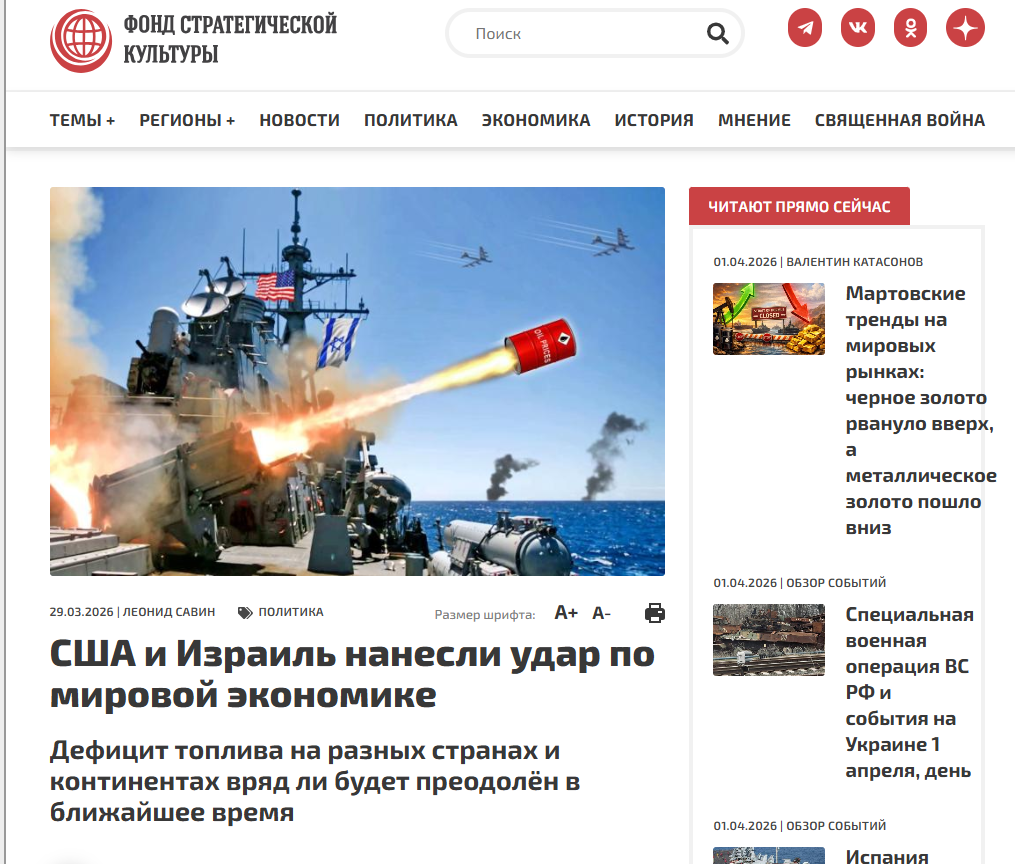

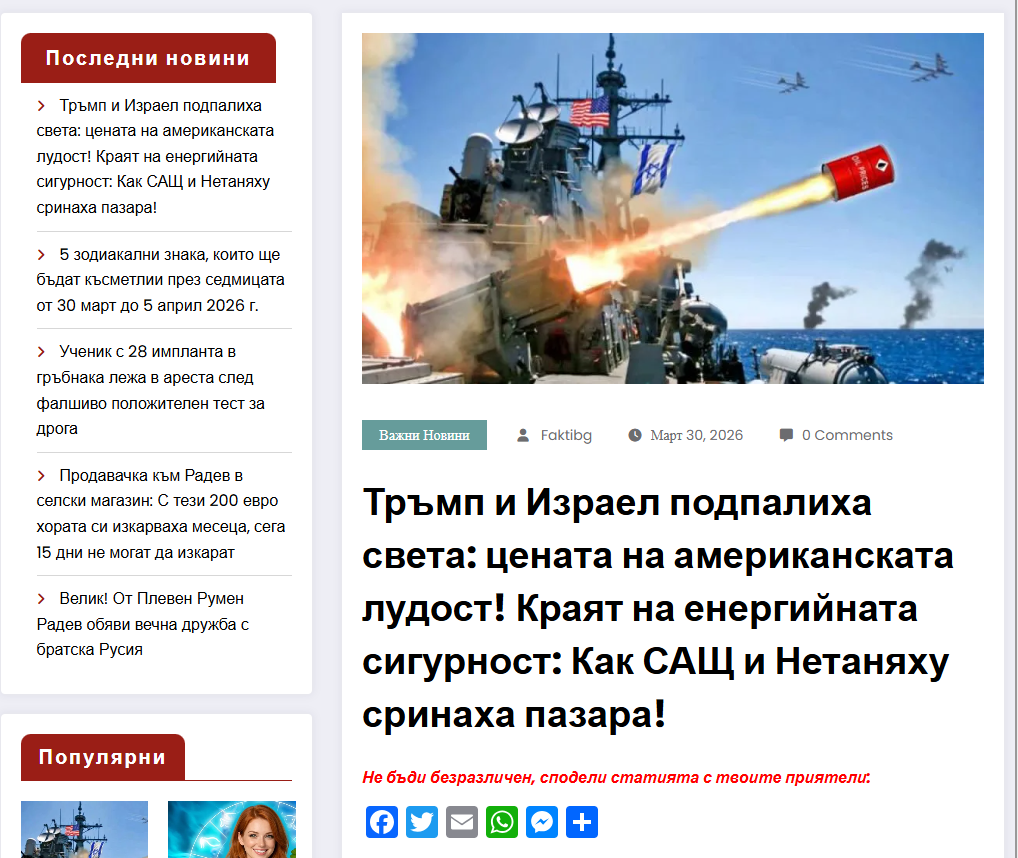

Поширення пропагандистських матеріалів відбувається за двоступеневою схемою. На першому етапі Pogled.info перекладає та подає пропагандистські матеріали як локальний контент. Далі ці тексти підхоплює faktibg.com — анонімний сайт, який у березні 2026 року передрукував щонайменше 99 статей із Pogled.info.

На другому етапі контент ще ширше розганяється через дві пов’язані фейсбук-сторінки — «Истинските новини в България» (приблизно 14 тисяч підписників) і «Новини от последния час» (приблизно 50 тисяч підписників). Разом ця мережа створює канал, через який російські наративи поширюються як нібито звичайні болгарські новини.

Які наративи просувають

У звіті йдеться, що ця інфраструктура підсилює одразу кілька небезпечних наративних кластерів: делегітимізацію ЄС, антинатовські меседжі та геополітичні конспірологічні схеми. Зокрема, матеріали просувають уявлення про «ворожий Захід», «морально зіпсований ЄС» і «зовнішню змову», яка нібито визначає політику в Європі.

Окремо слід наголосити, що така риторика під час виборчого періоду має підвищений ризик, оскільки здатна посилювати поляризацію та впливати на політичні настрої виборців. Адже вже 19 квітня 2026 року пройдуть чергові парламентські вибори, які стануть уже восьмими за п’ять років.

Чому це важливо

Часті вибори в Болгарії створюють особливо вразливе середовище для дезінформації, бо суспільство перебуває в постійному політичному напруженні. У таких умовах навіть добре замаскований пропагандистський контент може швидко поширюватися та впливати на порядок денний, підриваючи довіру до ЄС, НАТО та демократичних інституцій.

Ця мережа працює не випадково, а як стабільний канал для швидкого перенесення російських наративів у болгарськомовне середовище. Саме тому автори закликають до моніторингу, скарг через механізми DSA та до реагування з боку платформ і національного регулятора.

Що показує звіт

Розслідування фіксує, що Pogled.info має значний трафік і широку мережу зворотних посилань, що підсилює видимість його матеріалів в інтернеті. Потенційні зв’язки власників таких сайтів з болгарським політичним середовищем свідчать про глибшу вбудованість цієї інформаційної інфраструктури у внутрішні мережі впливу. Власником компанії, що управляє сайтом Pogled.info, за даними Center for the Study of Democracy, є Румен Петков, колишній член Болгарської соціалістичної партії та кандидат на виборах 2023–2024 років від коаліції «Levitzata!» («Лівиця!»).

Отже, мова йде не просто про окремий проросійський сайт, а про цілу систему перенесення, маскування та розповсюдження контенту, яка дає змогу кремлівській дезінформації обходити обмеження й виходити на широку аудиторію.