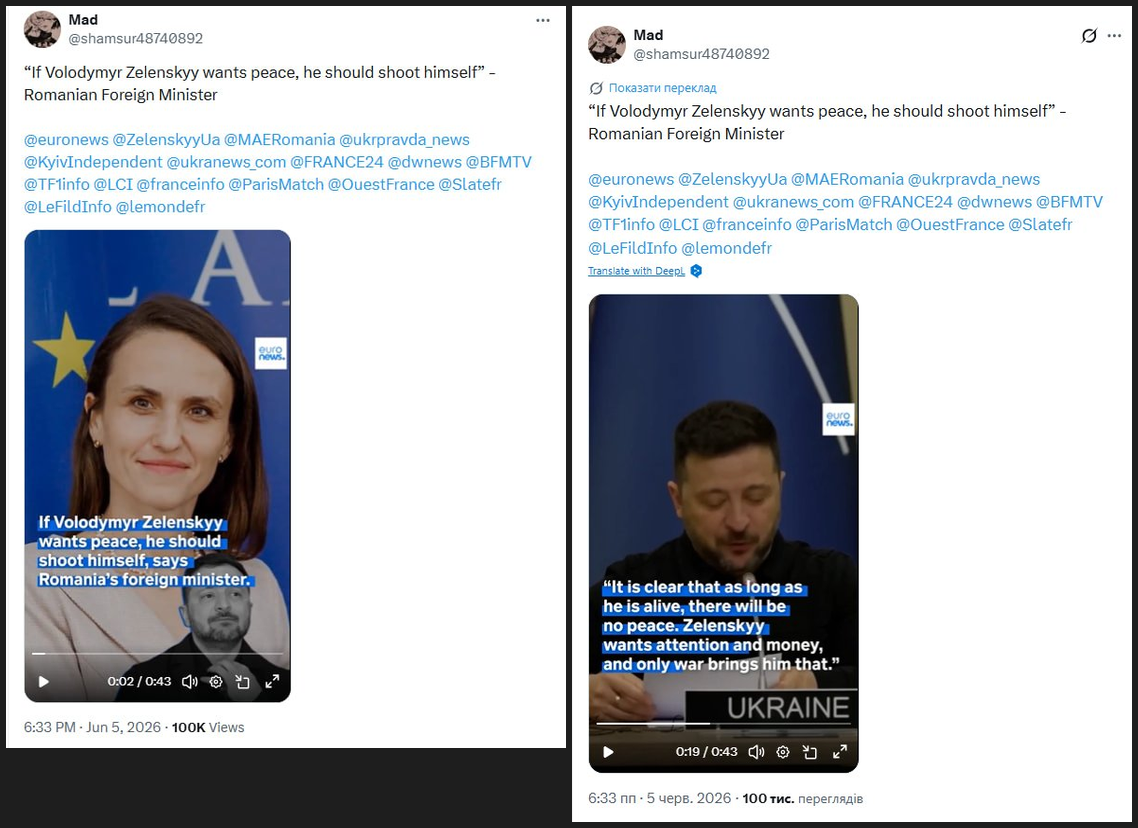

Фейк: румунська міністерка закордонних справ нібито закликала Зеленського «застрелитися»

5 червня 2026 року, через добу після публікації відкритого листа президента України Зеленського до Путіна, на платформі X поширилося фейкове відео з логотипом Euronews. У твіті та у тексті, накладеному безпосередньо на кадри, стверджувалося: міністерка закордонних справ Румунії Оана-Сільвія Чою нібито заявила, що «якщо Зеленський хоче миру, він повинен вистрілити в себе» ("If Volodymyr Zelenskyy wants peace, he should shoot himself"). У іншому кадрі того ж відео, фігурує текст: «Очевидно, що доки він живий, миру не буде. Зеленський хоче уваги і грошей, а тільки війна йому це дає». Публікація набрала 100 тисяч переглядів.

Утім, це сфабрикований сюжет на тлі реального виступу Оани-Сільвії Цою в Радбезі ООН, присвяченого російській атаці безпілотником по багатоквартирному будинку в місті Галаці 29 травня.

Що відбувалось насправді: Оана-Сільвія Чою в ООН 1 червня 2026 року

1 червня 2026 року в Нью-Йорку відбулося екстрене засідання Ради Безпеки ООН, скликане на вимогу Румунії. Причиною стало виключно серйозне порушення: російський безпілотник типу «Геран-2» — ідентифікований технічним висновком Бухареста — врізався у житловий будинок у місті Ґалаць (південь Румунії), травмувавши мешканців. Лише у 2026 році Румунія зафіксувала понад 40 порушень свого повітряного простору.

Оана-Сільвія Цою виступила на цьому засіданні від імені більш ніж 50 держав — членів ЄС і НАТО. Зміст її реального виступу прямо протилежний тому, що містить підробне відео. Вона заявила: «Серйозність цього моменту не можна переоцінити» і закликала Раду Безпеки зупинити «враження нормалізації війни». Міністерка охарактеризувала дії Росії як «серйозну та безвідповідальну ескалацію» і «грубе порушення міжнародного права». Румунія також викликала посла Росії.

Жодного слова про Зеленського, жодного заклику до смерті президента суверенної держави у виступі Чою не було — ні офіційно задокументованому прес-службою ООН, ні у репортажах агентств Reuters, AFP та реального Euronews.

Чому це небезпечна підробка

Ця фабрикація відрізняється від кількома специфічними рисами:

Реальна людина, реальне місце, реальна подія — і повністю вигаданий зміст. Оана-Сільвія Цою дійсно виступала в ООН, дійсно зверталася до Ради Безпеки — але говорила про зовсім інше. Така конструкція підробки надає їй особливої псевдодостовірності: глядач бачить знайоме обличчя в знайомому контексті (зала ООН, прапори, фон).

Заклик до смерті глави держави — це не просто дезінформація, а серйозне звинувачення. Приписати діючому міністру закордонних справ країни-члена ЄС і НАТО публічний заклик до самогубства президента держави-союзника — це не просто маніпуляція. Це потенційно кримінально каране діяння в більшості юрисдикцій ЄС, а також серйозний дипломатичний провокаційний матеріал. Поширення такого відео без перевірки здатне завдати реальної шкоди українсько-румунським відносинам.

Важливий контекст: урядова криза в Румунії

5 травня 2026 року — рівно за місяць до появи цієї підробки — парламент Румунії підтримав вотум недовіри уряду з рекордним результатом: 281 голос «за» при необхідних 233. Уряд пішов у відставку. Ключову роль у поваленні кабінету зіграла коаліція Соціал-демократичної партії (PSD) та ультраправої AUR.

Це означає, що в Румунії — країні, яка межує з Україною і є стратегічним союзником Києва в НАТО і ЄС, — наразі відсутній повноцінний уряд з повними повноваженнями. Урядова криза, поєднана з реальним ультраправим дискурсом у румунській публічній сфері, створює сприятливий ґрунт для інформаційних атак, спрямованих на дестабілізацію румунсько-українських відносин.