Фейкові зображення поширюються соціальними мережами після атаки США на Іран. Як відрізнити справжні кадри від підробних

Зображення та відео вибухів, пожеж, протестів та різноманітних типів озброєння активно поширювалися після початку атаки Ізраїлю на Іран і стали вірусними після удару Сполучених Штатів 21 червня по трьох іранських ядерних об'єктах. Але багато з них не показували того, що насправді відбувалося. Натомість вони були згенеровані штучним інтелектом, вирвані з контексту або записані з відеоігор чи авіасимуляторів. Багато з них були поширені акаунтами X із синіми галочками, які раніше асоціювалися з акаунтами людей або організацій з підтвердженою ідентичністю, але тепер їх можна придбати. Видання PolitiFact перевірило деякі оманливі зображення та відео про атаку США та реакцію на неї.

Згенеровані ШІ зображення часто містять візуальні невідповідності

Акаунт із синьою галочкою на X під назвою "Ukraine Front Line" опублікував 22 червня відео, яке показує блискавку, що вдаряє у стовп диму, після вибуху. Підпис попереджав про ядерну війну: «Будь ласка, зверніть увагу на блискавку! Це найвірніша ознака того, що вибух справді був ядерним». Але відео не показує реальну подію. Воно було завантажене 18 червня на ютуб з підписом «ai video». В описі акаунту зазначено: «Всі відео на цьому каналі створені за допомогою штучного інтелекту».

Деякі генеративні моделі ШІ дозволяють людям писати запити для створення реалістичних відео, і результати стають усе більш досконалими. Але вони не ідеальні, і уважний погляд на відео часто виявить візуальні невідповідності. Одне відео з підписом «Готуємося до (сьогоднішнього) удару» показувало вантажівки з іранськими прапорами, що везуть ракети. Ближчий погляд показав, що лінії на дорозі були нерівними, шина на другій вантажівці, здавалося, мала вирваний шматок, і символи на прапорах також не відповідали справжньому іранському прапору.

Хані Фарід, професор Каліфорнійського університету в Берклі, який спеціалізується на цифровій криміналістиці, написав у LinkedIn, що багато згенерованих ШІ відео часто тривають вісім секунд чи менше або складаються з восьмисекундних кліпів, змонтованих разом. Це тому, що Google Veo 3, модель перетворення тексту на відео, має обмеження у вісім секунд. Деякі відео мають видимі водяні знаки, але користувачі можуть їх обрізати.

Під час цієї війни і проізраїльські, і проіранські акаунти поширювали зображення ШІ. Емманюель Саліба, головний офіцер з розслідувань компанії цифрової криміналістики Get Real Labs, сказала BBC Verify, що це «перший раз, коли ми побачили генеративний ШІ, який використовується в такому масштабі під час збройного конфлікту».

Дезінформатори продовжують поширювати старі зображення та відео поза контекстом

Поряд зі збільшенням використання ШІ не бракувало зображень та відео, які поширювалися з неправильним контекстом.

«Масові протести спалахнули по всій Америці, коли громадяни вийшли на вулиці в обуренні після того, як США завдали удару по Ірану», — таким був підпис до публікації в X від 22 червня. Але відео було завантажено 14 червня, в день протестів «No Kings» по всій країні.

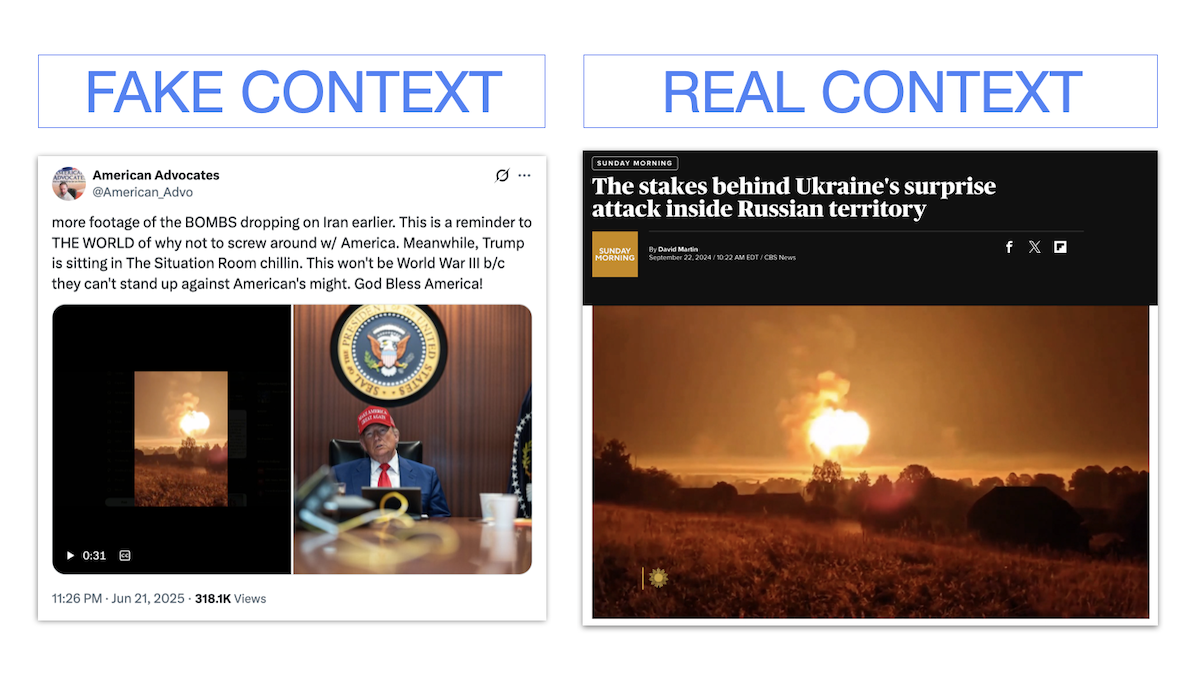

Інше відео в X, поширене вночі після атак США, показувало великий стовп вогню та диму. «Більше кадрів БОМБ, що падають на Іран раніше», — таким був підпис до відео. Але це неправда; відео було взято з новини про атаку українських безпілотників у 2024 році.

Зворотний пошук зображень може розкрити, чи публікувалося відео в інтернеті раніше і який був оригінальний контекст. Інструменти як Google Lens та TinEye можуть показати, де зображення або відео поширювалися на платформах, хто їх публікував і коли була зроблена найраніша публікація. Підписи до зображень, опублікованих новинними виданнями, ймовірно, покажуть, коли і де вони були зроблені.

Кадри з відеоігор використовують сценарії попередніх конфліктів

Зображення, записані з авіасимуляторів та військових відеоігор, також неправильно представляють конфлікт. «Це B2 Spirit Stealth Bomber злітає в Каліфорнії!» — із таким підписом був зроблений пост у X від 21 червня акаунту з синьою галочкою, перед атакою на Іран. За винятком того, що це не був справжній бомбардувальник B2. Перевірка водяного знаку відео веде до акаунту в тіктоку, який опублікував відео 15 травня з хештегом #microsoftflightsimulator, симуляційною грою, доступною на Xbox.

Геймплей з відеогри «Arma» також піддається неправильному використанню під час збройних конфліктів. PolitiFact перевірив твердження, які використовували кадри «Arma» під час війни Росії з Україною та війни Ізраїлю з ХАМАСом. Пошук за ключовими словами на відеоплатформах, таких як ютуб, може показати, чи відповідають відео кадрам з відеоігор, які раніше були завантажені.

Прості способи аналізу акаунтів на предмет надійності

Перевірка профілю та біографії акаунту допоможе розкрити, чи є він надійним. Багато хибних та оманливих тверджень надходили від акаунтів з іранським прапором як фото профілю та іменами, які можна сплутати з тими, що дають легітимні новинні оновлення.

Такі акаунти включають «Iran Updaes Commentary» (з помилкою) та «Iran News Daily Commentary». Інший акаунт — з синьою галочкою — називається «Iran's Reply».

Але вони не пов'язані з іранським урядом або будь-яким надійним джерелом. PolitiFact виявив, що публікації на цих акаунтах отримують сотні тисяч, якщо не мільйони переглядів, але містять низькоякісний контент, такий як згенеровані ШІ зображення.

Авторка публікації на PolitiFact — Loreben Tuquero