Фейкове ШІ-відео з «українським солдатом» створене на основі обличчя російського блогера

На початку листопада в грузинській частині фейсбуку поширювалося відео з молодим чоловіком в армійській уніформі. Він ридає, стверджуючи, що його силоміць відправляють на фронт, він не бажає гинути, та закликає глядачів розповсюдити ролик. У супровідному описі зазначено: «Клоуни змушують молодь воювати». Багато коментаторів сприйняли героя відео як українського військового. Розвінчали цей фейк грузинські фактчекери mythdetector.

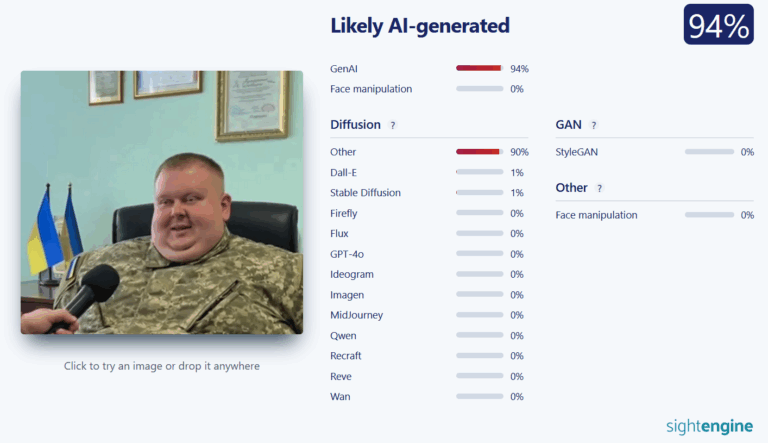

Насправді це ролик, згенерований штучним інтелектом, з маніпулятивним закликом до військової допомоги. Він містить характерні для ШІ помилки, а його першоджерело — акаунт у тіктоку, який раніше завантажував подібний фейковий контент.

У відео помітні технічні вади, властиві контенту від штучного інтелекту. Обличчя мовця та його сльози виглядають штучно: зображення надто гладке, сльози на підборідді й носі неприродно сяють. Якщо придивитися до окулярів, то в деяких місцях вони наче зливаються з обличчям.

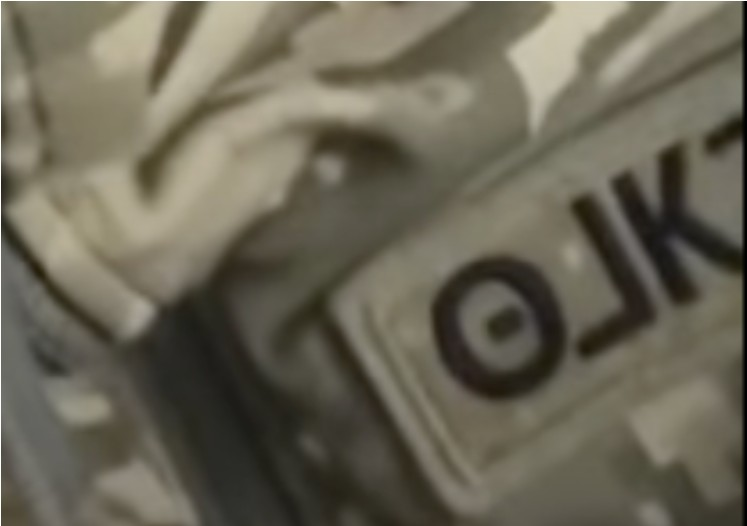

Крім того, на уніформі є шеврон, де мав би бути напис з прізвищем бійця, але замість цього видно розмиті, нечитабельні символи — типова проблема для ШІ-генерації.

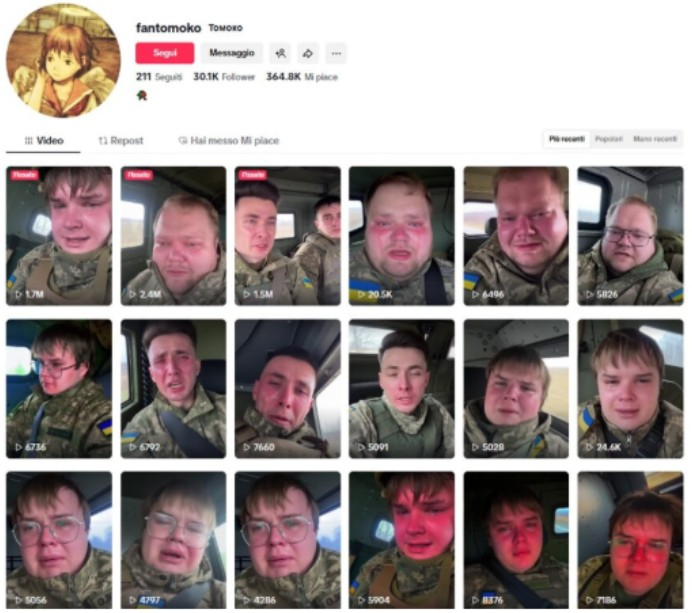

За підписом, відео походить з тікток-акаунту fantomoko, який нині заблоковано. Фактчекери Myth Detector проаналізували схожі ролики, які цей користувач поширював раніше. Наприклад, в одному з ШІ-відео, що циркулювало в російськомовних і грузинськомовних спільнотах, «український солдат» заявляв, що йому 23 роки та його примусово мобілізували.

Станом на 4 листопада в акаунті fantomoko було кілька аналогічних матеріалів. Деякі показували «українських вояків», інші — фігури з російським прапором на формі. Зміст варіювався: від слізних скарг про примус до війни до сцени, де людина тримає український прапор біля Кремля.

Ці ролики також дослідила італійська фактчекінгова платформа Open, яка встановила особу, чиє обличчя використовували для ШІ-генерації. Виявилося, що один із «героїв», чиє обличчя стає шаблоном чи не найчастіше, — це російський відеоблогер під ніком kussia88, відомий на ютубі як KASHA STREAM. Порівняння облич підтверджує, що у фейковому відео застосовано саме його риси.

Російські пропагандисти та пов'язані з ними мережі поширюють такі ШІ-згенеровані фейки з метою маніпуляції громадською думкою, особливо в країнах з потенційним скептицизмом до підтримки України.